Introducción

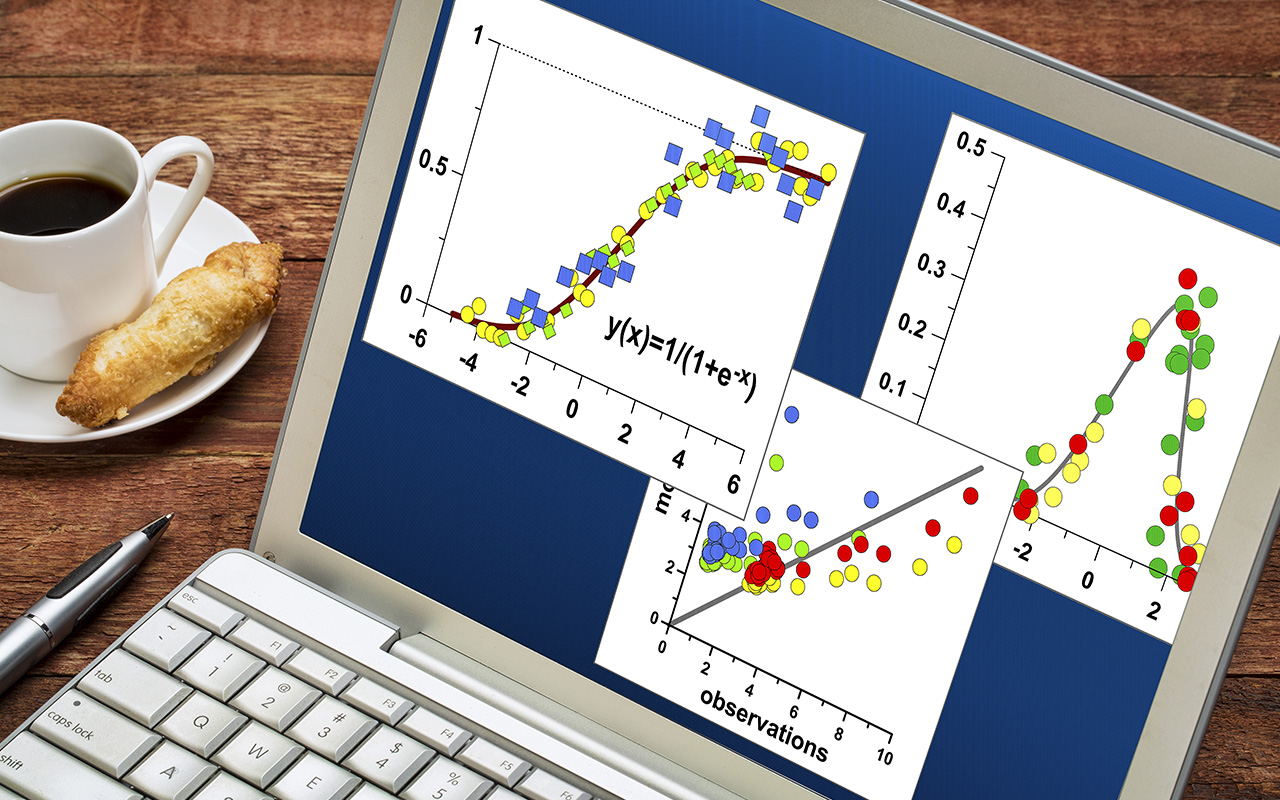

En numerosas ocasiones, como resultado de una investigación experimental, los datos que son registrados y analizados presentan ciertas relaciones entre ellos, las cuales pueden ser útiles para predecir, por ejemplo, el comportamiento de una variable con respecto a otra.

Existe una inmensurable cantidad de problemas científicos que involucran más de dos variables, sin embargo, en esta unidad se estudian aquellos modelos donde a lo sumo interviene una sola variable independiente. Primero se examina la regresión lineal entre dos variables aleatorias, con la cual se determina si existe una relación de tipo lineal entre ellas, lograr cuantificar esa relación y realizar ejercicios de predicción de valor de una variable con la información que se tiene acerca de la otra. También se analiza cómo dentro de un conjunto de observaciones puede existir dependencia entre dos variables mediante el desarrollo del concepto de correlación.

Propósitos de aprendizaje

Propósito general

Desarrollar los conceptos de regresión y correlación, con el fin de encontrar la forma en la que dos variables están relacionadas y determina su grado de asociación.

Propósitos específicos

- Calcular los valores de los parámetros de una recta que le permitan ajustarse de la forma más adecuada a un conjunto de datos.

- Explicar cómo se puede obtener el valor que tiene una variable mediante la información contenida en un modelo de regresión lineal.

- Determinar el grado de dependencia entre dos variables utilizando diversos coeficientes de correlación que permitan realizar una cuantificación.

Regresión Lineal

En la vida práctica, una variable aleatoria se encuentra relacionada como mínimo con una variable de tipo predictivo, en algunos casos con varias. Esto trae como consecuencia que se deberían usar valores de las variables predictivas con el fin de calcular de forma más precisa el valor promedio de la variable aleatoria o en algunos casos para dar un pronóstico sobre el comportamiento de esta en el futuro.

En un análisis estadístico se manipulan con frecuencia datos cuantitativos de tipo bivariado, es decir, que a cada elemento de la muestra tiene asignado un par de medidas.

La regresión lineal permite establecer una ecuación matemática que muestra la relación entre dos o más variables, con lo cual se logra hacer una estimación o predicción sobre el comportamiento de las mismas. En esta unidad, se explica el caso de dos variables relacionadas entre sí, por tanto el modelo lineal descrito utiliza una variable dependiente Y y una variable independiente X. Bajo el concepto de regresión lineal, una variable independiente proporciona el fundamento para realizar la estimación, mientras que la variable dependiente es quien da la estimación o predicción.

|

En el año 1877, Sir Francis Galton introdujo por primera vez el término de regresión, mientras que simultáneamente realizaba importantes aportes en el desarrollo del concepto de correlación (Academia, 2018). Si en el modelo considerado únicamente intervienen dos variables, la técnica se denomina regresión o correlación simple. En los casos que se involucra un número mayor de variables (varias dependientes y una sola independiente) la regresión o la correlación recibe el adjetivo múltiple. |

Regresión Lineal

Nociones básicas

Como se estudió en la unidad pasada, las representaciones gráficas proporcionan una primera idea acerca de cómo se encuentra relacionada la información recogida a través de alguna prueba o experimento. En el caso de la regresión lineal, los valores de las variables dependiente e independiente se representan a través de un diagrama de dispersión, el cual utiliza el plano cartesiano, generalmente en su primer cuadrante. La variable dependiente se encuentra en Y y la variable independiente en X.

Una línea de regresión es un trazo dentro del diagrama de dispersión, el cual debe corresponder a una línea que pasa lo más cerca posible de la mayoría de los puntos graficados; esta línea atraviesa la nube de puntos haciendo que la distancia entre la línea y los puntos sea lo menor posible. Como cada experimento realizado presenta una posición propia de los puntos, la línea de regresión que se ajusta a cada situación es diferente.

Si las variables tienen una relación lineal, la línea de regresión corresponde a una recta, cuya ecuación se caracteriza por tener la forma: y = mx + b, donde m representa la pendiente de la recta y b el punto de intersección con el eje Y. La pendiente corresponde a la razón entre la variación de la variable dependiente Y y el incremento de la variable independiente X. Si Y aumenta, la pendiente será positiva, si por el contrario Y se decrementa, el valor de la pendiente será negativo.

|

Estudiemos el siguiente ejemplo para una mejor comprensión de una línea de regresión. |

Regresión Lineal

Ajuste por el método de mínimos cuadrados

Cuando se trata de una relación lineal entre variables, se utiliza una ecuación de la recta que describa una línea de regresión que posea el mejor ajuste con respecto a la nube de puntos. Desde el punto de vista estadístico, la línea recta de regresión se representa con la siguiente expresión:

Dónde:

Los valores de a y b corresponden a constantes ya que su valor no cambia cuando se trabaja sobre una sola recta en particular. Además, se debe aclarar que la variable dependiente aparece representada con Y circunfleja (Ŷ), dado que al estar trabajando con una muestra, sus valores son estimados. También se dice que Ŷi es el valor que se predice de Y para la observación i.

La línea de regresión se debe ajustar de la mejor forma con los datos, esto quiere decir que se desea encontrar la línea recta que permita obtener la diferencia más pequeña posible entre el valor real Y y el valor de la predicción Ŷ. Por tanto, se tiene que ∑(Yi - Ŷi)2 o su equivalente ∑[Yi - (a+bXi)]2 debe ser mínima. Profundicemos en el tema estudiando la siguiente interactividad.

|

Gráficamente se busca minimizar las distancias verticales entre la línea recta de regresión y los puntos. |

Regresión Lineal

Desviación estándar en regresión

En el caso de estadística descriptiva, la desviación estándar trabaja en una sola dimensión en la recta numérica o también denominada eje X y su interpretación se hace como un intervalo. La desviación estándar en regresión también conocido como error estándar de estimación, trabaja en un sistema de dos dimensiones, ya que acá se hace uso de dos variables y su interpretación se hace en el plano con líneas paralelas a la línea de regresión, los cuales crean franjas que también podrían ser examinadas como intervalos.

La desviación estándar de regresión se utiliza para evaluar el error de las estimaciones realizadas a los valores muestrales Yi con base en la ecuación de regresión Ŷ. La ecuación matemática que permite calcular la desviación estándar de regresión:

En la ecuación anterior se requieren los valores de Ŷ, por tanto, en ocasiones es preferible utilizar el modelo que se establece con los datos iniciales, de la siguiente manera:

La interpretación que se le da a Syx con respecto a la línea de regresión Ŷ es similar a la utilizada en estadística descriptiva para la desviación estándar σx con respecto a la media aritmética x. De esta manera, si los valores de Y siguen una distribución normal, las distancias ±1, ±2, ±3 y ±4 veces de la desviación estándar de regresión Syx, contendrán el 68.26%, 95.44%, 99.74% y 99.98% de los valores respectivamente; entonces se tiene el siguiente modelo:

Entre más grande sea el esparcimiento de los puntos alrededor de la línea de regresión, más alto será el valor de Syx.

|

Repasemos este concepto con el siguiente ejemplo de desviación estándar en regresión. |

Correlación

El objetivo del análisis de correlación es calcular un indicador numérico que resuma el grado de relación entre dos o más variables. Esto es relevante para un investigador que desea determinar cuáles de las variables que ha estudiado son las más importantes y presentan una fuerte relación o asociación entre ellas.

El análisis de correlación, en comparación con el análisis de regresión, busca estimar el nivel de asociación entre las variables. En este caso, no se usa una variable como herramienta de predicción de la otra, sino para encontrar esa fuerza de relación (también llamada covarianza) entre las variables asociadas a una ecuación de regresión.

Correlación

Coeficiente de correlación

Si el análisis de correlación se lleva a cabo en un conjunto de datos, el coeficiente de correlación (denotado con la letra r) de la muestra se puede calcular de forma directa de los datos originales, con el uso del siguiente modelo (Walpole, Myers, & Ye, 2012):

Este modelo puede simplificarse así:

Si se tiene a disposición el valor de los coeficientes de regresión, la ecuación sería:

|

A continuación se presenta un ejemplo de coeficiente de correlación. |

Correlación

Variaciones de la correlación

Las variaciones se utilizan para señalar si la desviación total Y - Y se reduce o no se reduce a causa de la introducción de los valores de X cuando se realiza el cálculo de los valores de Ŷ. Existe una desviación que se conoce como “explicada” y consiste en que el valor de Ŷ- Y se reduce por el uso de la variable X, mientras que la desviación denominada “no explicada” conduce a que Ŷ- Y no se reduce por el uso de la línea de regresión.

Basado en lo anterior, el promedio de Y ~\left( \bar{y}=\frac{\sum {{y}_{i}}}{n} \right) es obtenido sin la necesidad de utilizar los valores de X, mientras que la ecuación de regresión Y, sí se obtiene con la influencia de los valores de X. Por tanto, si los valores de Y están relacionados con los de X (en algún grado), las desviaciones de los valores de Y con respecto a Y se reducirán debido a la introducción de los valores de X al calcular los valores de Ŷ. Esta operación solo aplica para puntos considerados de forma individual, no para un conjunto de puntos. Estudiemos el siguiente ejemplo.

|

El coeficiente de determinación también se utiliza como un indicador numérico del grado de relación entre dos variables, el cual, corresponde al cuadrado del coeficiente de correlación, es decir, r2. Este coeficiente es obtenido al analizar la relación entre los valores originales y los que se obtienen de la línea de regresión, así como la relación que existe entre los valores originales con su promedio aritmético. En este caso, ambas relaciones se dan con respecto a la variable dependiente Y. El gráfico de la pantalla principal detalla un poco más este concepto. |

Correlación

Coeficiente de determinación

Otro indicador que permite medir el grado de relación entre dos variables, es el coeficiente de determinación que se denota con r2. Se define como el cociente entre la variación explicada y la variación total, de la siguiente forma:

Cuando la línea de regresión pasa por los puntos de Y, se obtiene la condición Ŷ = Y, la cual conduce a la igualdad \sum {{\left( \hat{Y}-\bar{Y} \right)}^{2}}=~\sum {{\left( Y-\bar{Y} \right)}^{2}}, y esta a su vez a que el coeficiente de determinación sea r2=1, que significa una correlación positiva perfecta. En otro caso, en el cual los puntos de Y se encuentran bastante dispersos y la línea de regresión alejada de ellos, ∑(Y - Ŷ)2 tiende a tomar un valor muy grande; asimismo, como la variación total se mantiene fija, se tiene que \sum {{\left( \hat{Y}-\bar{Y} \right)}^{2}} toma un valor pequeño, lo cual hace que r2 tienda a cero, es decir no existe una correlación basada en la recta de regresión. De esta forma se establece el rango de valores que puede tomar r2, el cual va de 0 a 1.

Lo anterior se puede resumir en que si r2 es cercano a 1, los valores de Y se encuentran muy cerca de la línea de regresión. Vale la pena anotar que como r2 siempre es un número positivo, no puede indicar si la relación que existe entre las variables es negativa o positiva. Repasemos este ejemplo de coeficiente de determinación.

|

En el siguiente video se muestra cómo se puede utilizar Microsoft Excel para obtener los coeficientes de regresión y correlación en un conjunto de datos. |

Correlación

Interpretación del coeficiente de determinación

Hay tres casos importantes que describen la relación entre las variables X y Y:

- Correlación positiva perfecta.

- Ninguna correlación.

- Correlación negativa perfecta.

Actividad de aprendizaje

|

Aplica, de acuerdo con lo estudiado, los conceptos de regresión y correlación de acuerdo al caso presentado. |

Inferencias en regresión y correlación

Los conceptos de inferencia estadística se pueden aplicar en regresión y correlación para llegar a conclusiones principalmente acerca de la pendiente poblacional de la línea de regresión β1 y del coeficiente de correlación poblacional p. De esta forma, es posible complementar el estudio del grado de relación entre dos variables.

Inferencias en regresión y correlación

Inferencia sobre la pendiente poblacional

Analizando el valor de la pendiente de la recta de regresión β1, se puede evaluar si existe una relación significativa entre las variables dependiente e independiente (X, Y). Si el valor de β1 es igual a cero se podrá concluir que no hay relación entre X y Y, si por el contrario, esta hipótesis es rechazada, quiere decir que hay una relación lineal. En consecuencia, las dos hipótesis se expresarán de la siguiente manera:

Para determinar la relación, se utiliza el estadístico de prueba siguiente (Delgado, 2008):

donde

Además, b representa la pendiente de la ecuación de regresión.

|

Estudiemos el siguiente ejemplo para reforzar este concepto anteriormente explicado. |

Inferencias en regresión y correlación

Inferencia del coeficiente de correlación poblacional

En este caso se utiliza el coeficiente de correlación r, para analizar la relación lineal entre dos variables. Para determinar si existe una correlación entre X y Y, se realiza la prueba de existencia de la relación lineal entre ellas. Se plantean las dos hipótesis, la nula en la que se asume que el coeficiente de correlación poblacional p es igual a cero y la alternativa en que se asume que toma un valor diferente de cero:

Caso de estudio

|

Aplica la regresión lineal para hacer una predicción en el siguiente caso de estudio. Recuerda presentarle los resultados al docente de clase. En la próxima unidad encontrarás adicionalmente la retroalimentación de este ejercicio. |

Resumen

En diversos tipos de experimentos y de situaciones prácticas, un investigador recolecta y/o analiza datos cuantitativos cuya naturaleza es bivariada. Es decir, como mínimo encuentra dos variables de las cuales es razonable asumir que tienen algún tipo de relación entre sí. En esta unidad se presentan las técnicas de regresión y correlación, las cuales suelen utilizarse para medir el grado de asociación entre dos variables con una relación lineal.

La unidad también presenta el método de ajuste por mínimos cuadrados para determinar la ecuación de la línea de regresión y así lograr realizar una predicción en el comportamiento de una variable. Se presentan varios ejemplos en los cuales se utilizan los conceptos de regresión y correlación en un conjunto de datos para obtener una estimación e inferencia de la relación entre las variables.

Por último, se utilizan técnicas de inferencia estadística para profundizar en el estudio de la pendiente poblacional y el coeficiente de correlación. Se utilizan pruebas de hipótesis para así tener conclusiones sobre el comportamiento de los parámetros.

Bibliografía ()

- Delgado, R. (2008). Probabilidad y estadística para ciencias e ingenierías. Madrid: Delta publicaciones.

- Novales, A. (2010). Análisis de Regresión. Madrid: Universidad Complutense de Madrid.

- Walpole, R., Myers, R., & Ye, K. (2012). Probabilidad y estadística para ingeniería y ciencias. (9na ed). Ciudad de México: Pearson educación.

Referencias Web

- Academia. (2018). Principales aportaciones de Sir Francis Galton. Recuperado de http://www.academia.edu/16145257/Principales_aportaciones_de_Sir_Francis_Galton_1822-1911

- Estadística en Investigación. (2018). Distribución “T” de Student. Wordpress. Recuperado de https://estadisticaeninvestigacion.wordpress.com/distribucion-t-de-student/