Introducción

Hasta este momento se han visto los conceptos y herramientas que se emplearán para el procesamiento de imágenes, ahora se trata de adquirir las competencias para aplicarlas en la degradación y restauración de imágenes para lograr obtener datos que sean útiles a los propósitos que se persiguen.

No siempre se consiguen las imágenes perfectas de los elementos de captura, es necesario hacerles procesos que permitan su mejora, por ejemplo, si se desea identificar a una persona en un ambiente oscuro y se tienen los registros en imágenes, pero no son lo suficientemente claros, se necesita, entonces, aplicar métodos que ayuden a restaurar las imágenes, a quitarles el ruido, hacer operaciones morfológicas o extraer características que permitan identificar a la persona.

La extracción de características de las imágenes como centroides, líneas y curvas permiten que se puedan contar y caracterizar qué clase de objetos hay en una imagen, permitiendo que las máquinas aprendan a reconocer patrones que luego serán el insumo de la visión e inteligencia artificial de los robots.

|

Le invitamos a conocer algunos de los comandos de Matlab® que le ayudarán en el desarrollo de las actividades planteadas en esta unidad. |

Propósitos de aprendizaje

Propósito general

Obtener la información apropiada de la imagen para ser procesada según las necesidades del algoritmo y la aplicación en donde se van a utilizar los datos recolectados, almacenados, procesados y analizados.

Propósitos específicos

- Predecir el comportamiento de las imágenes cuando son alteradas con ruido, métodos de convolución, dilatación, erosión y operaciones morfológicas.

- Extraer de las imágenes características como centroides, líneas y curvas.

- Desarrollar algoritmos para contar objetos en las imágenes según los requerimientos de la aplicación.

Degradación y restauración

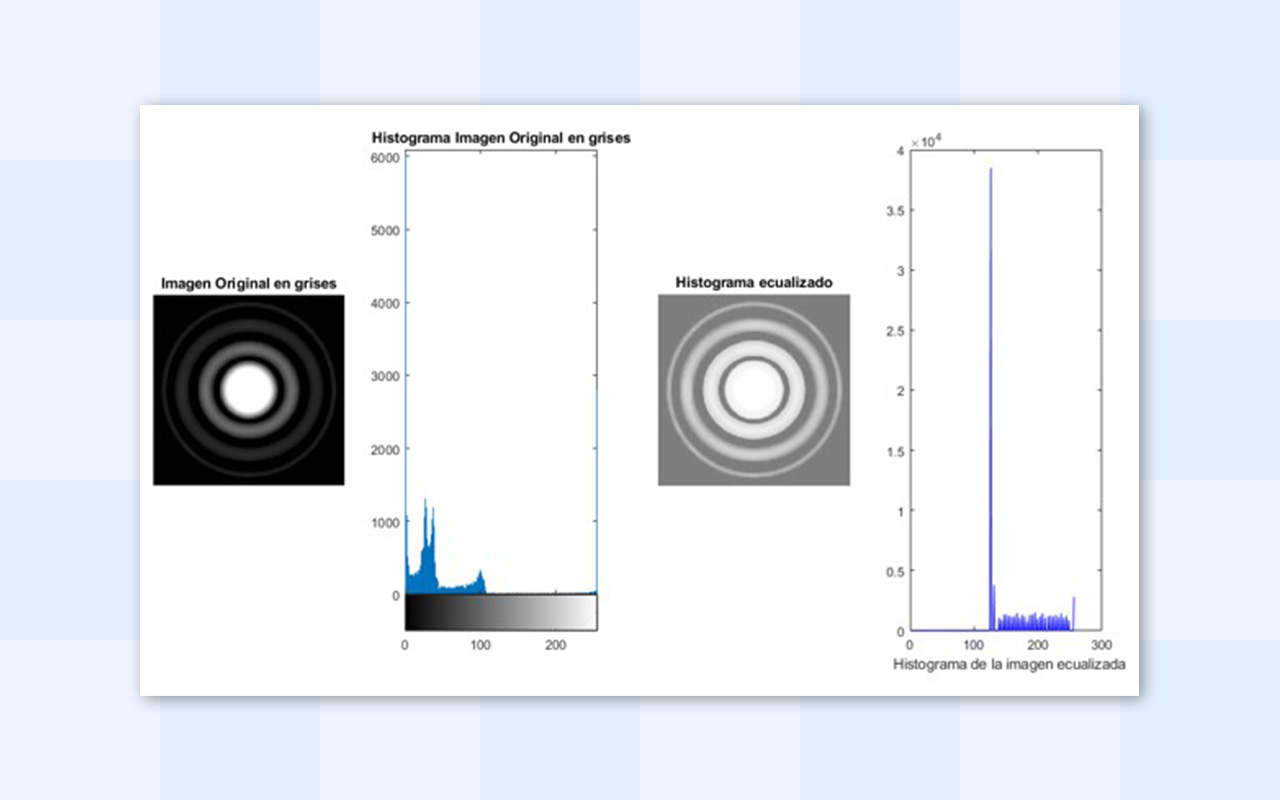

El objetivo de las técnicas de restauración consiste en mejorar la imagen de alguna manera. Por ejemplo, la supresión de ruido en una imagen es considerada una técnica de restauración. Obtener la imagen perfecta dada la imagen muestreada es la meta de la restauración, en algunas circunstancias no es posible, pero se hacen lo necesario para mejorar la calidad de los datos.

Cuando se toma una fotografía se presentan defectos que se pueden corregir, los defectos suelen ser producidos por el movimiento de la cámara y el objeto, desenfoque, iluminación inadecuada, suciedad en los lentes y otros factores que deterioran los datos de las imágenes.

|

La restauración de la imagen es el arte de mejorar la calidad de una imagen con base a una medición absoluta. Implica, generalmente, algunos métodos de deshacer una distorsión que ha sido impuesta, por ejemplo, un movimiento borroso o el grado de aspereza. |

Las técnicas de restauración de la imagen son de naturaleza matemática y estadística. Matemáticamente se puede expresar la degradación como un modelo H, que junto con un término de ruido aditivo η(x,y) opera sobre una imagen de entrada f(x,y) para producir una imagen degradada g(x,y).

La restauración de imágenes digitales puede observarse como el proceso de obtener una aproximación a f(x,y), dado g(x,y) y un conocimiento de la degradación en forma del operador H. El ruido es de naturaleza estadístico, esto quiere decir que no se puede determinar con exactitud el lugar en donde estará presente y el momento de su aparición.

|

Haga clic aquí para escuchar una información útil. |

En esta unidad, utilizaremos los resultados y las definiciones que se obtienen para los interesados en profundizar sobre la matemática que soporta la degradación y restauración de imágenes.

Actividad de aprendizaje

|

Haga clic aquí para realizar una actividad sobre comandos o funciones de Matlab para el procesamiento de imágenes. |

Degradación y restauración

Agregar ruido a una imagen

El ruido es una información no deseada que contamina la imagen, aparece en las imágenes de diferentes fuentes y se retira utilizando filtros. Estos filtros son de diferente tipo como los lineales y lo no lineales, más los que se encuentran en la literatura de procesamiento de imágenes.

Para probar la efectividad de los filtros sobre imágenes es necesario medir sus efectos a partir de imágenes que lo contengan. Por ejemplo, si se desea crear un nuevo tipo de filtro para eliminar ruidos las pruebas de investigación necesitan fabricar artificialmente imágenes con ruido, es decir, tomar la imagen por medio de dispositivos de captura y añadirle los artefactos o estructuras por programación.

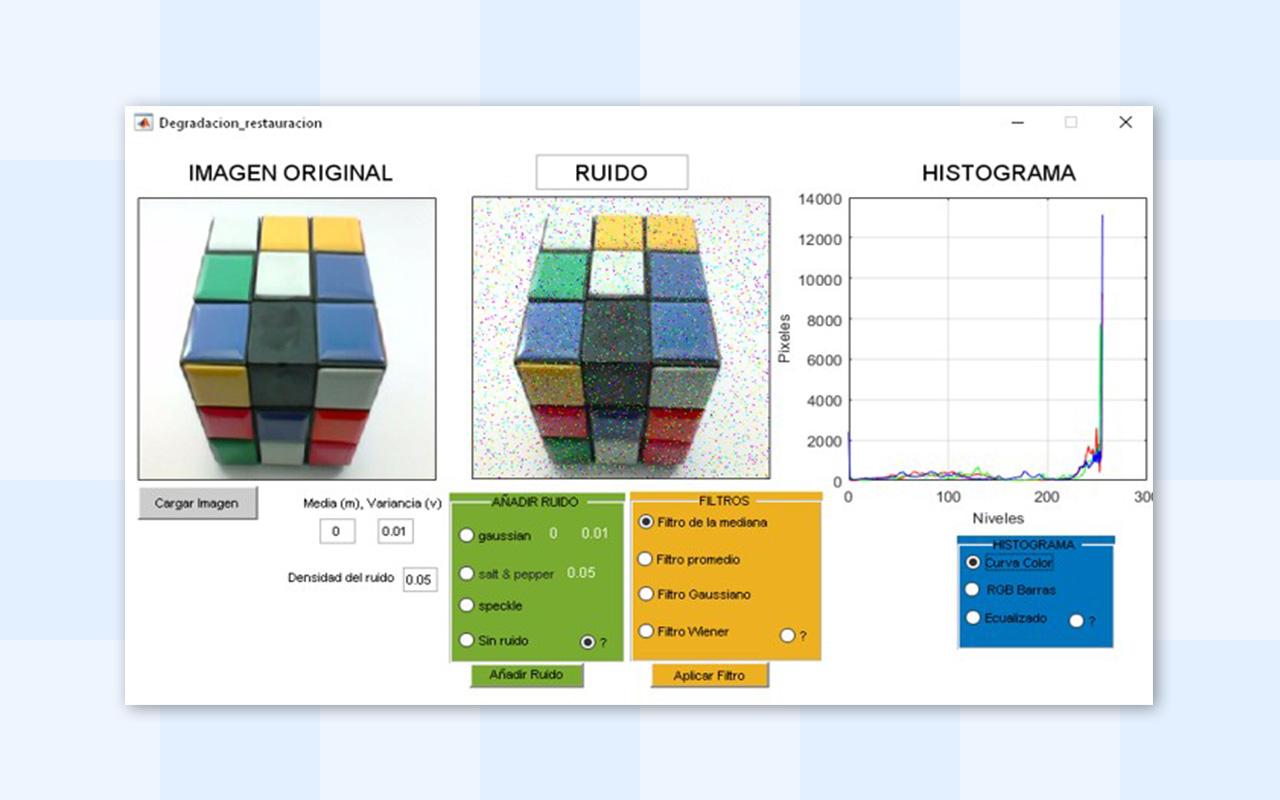

El tipo de ruido que puede modelarse y añadirse puede ser tan complejo como sea necesario, para esta sección se realizará una actividad utilizando una interface gráfica que permita añadir los ruidos más utilizados y que según las estadísticas son los que más aparecen en las imágenes, además, utilizar los filtros existentes para eliminarlos.

|

En el siguiente video se presenta la utilización de una aplicación que permite variar los diferentes parámetros para degradar las imágenes, al aplicarle ruido y ver en tiempo real los efectos sobre la imagen y sobre las matrices, se utiliza una imagen de tamaño 10x10 para poder analizar los cambios de datos que se producen en los pixeles de las tres matrices RGB. Se implementa en la misma aplicación los filtros que ayudan a restaurar la imagen, permitiendo variar los parámetros de los filtros y experimentar el efecto que se logra con las modificaciones. |

Actividad de aprendizaje

|

Ahora que ya observó el video, desarrolle la siguiente actividad. |

Degradación y restauración

Correlación cruzada vs Convolución

Correlación cruzada

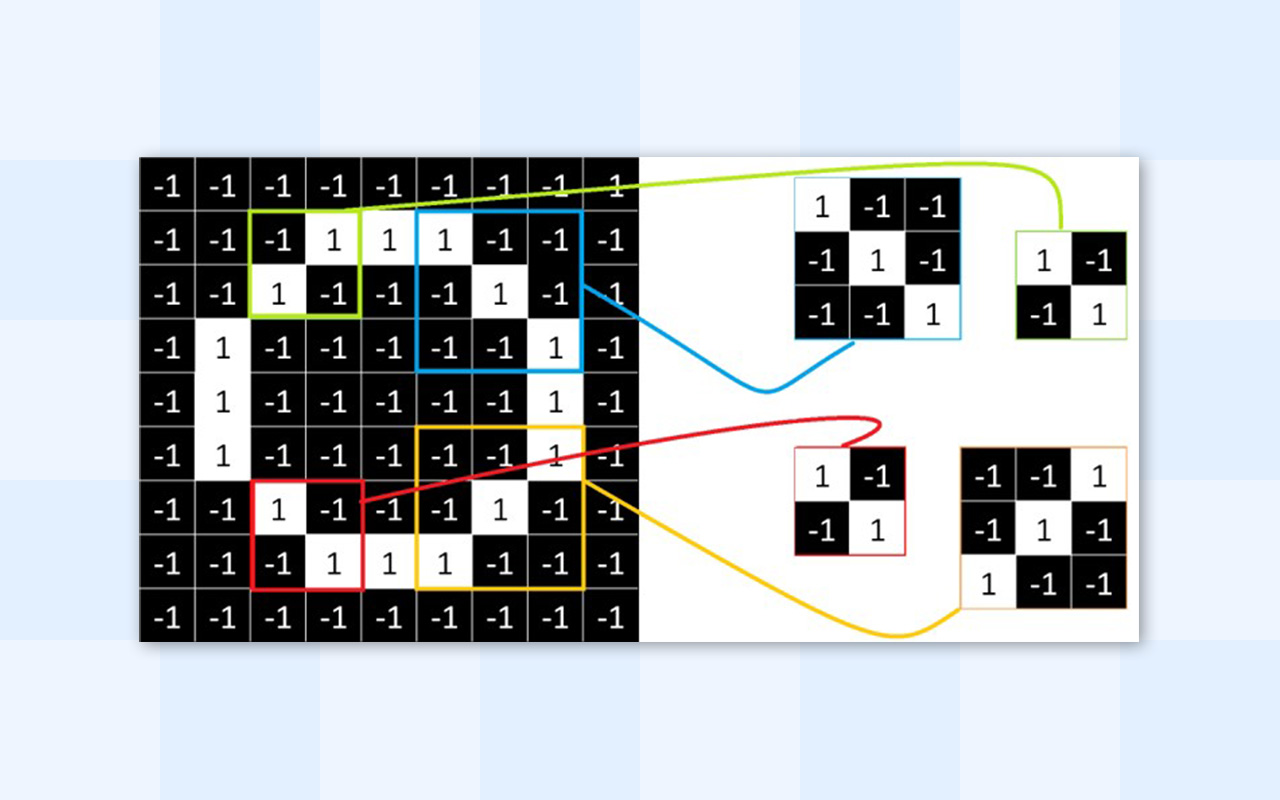

La correlación es una operación que se asemeja a la convolución, de la cual se hizo referencia cuando se trataron los temas de filtros de la mediana y promedio, en donde los pixeles resultantes se originan con operaciones matemáticas específicas en cada filtro. Para la correlación cruzada el pixel resultante, después de aplicarle la máscara, se calcula como la suma ponderada de los pixeles vecinos. A la máscara o matriz se le da el nombre de núcleo o kernel de correlación y la más utilizada es la de tamaño 3x3. La correlación de f(x,y) y H(x,y) está dada por la ecuación:

g\text{ }\left( x,y \right)\text{ }=\text{ }h\left( x,y \right)*\text{ }f\left( x,y \right)\text{ }=\sum \underset{i,j=-\infty }{\overset{\infty }{\mathop \sum }}\,f\left( i,j \right)h\left( x+i,y+i \right)~

Con la correlación cruzada se trata de encontrar en una imagen la coincidencia que aparece al compararla con una subimagen. Si los pixeles de las imágenes que se están comparando son iguales o parecidos se dice que están altamente correlacionados.

|

En la sección de coincidencias de plantillas se realizarán los cálculos para determinar el índice de correlación de las matrices y de esta forma determinar sus coincidencias. |

Convolución

La convolución se utiliza para el filtrado de imágenes no se acostumbra a emplear para encontrar la coincidencia entre imágenes. En la Convolución de un pixel en una imagen y una máscara se obtiene calculando la suma ponderada de los pixeles vecinos al pixel de interés. La convolución de f(x,y) y h(x,y) está dada por la ecuación:

g\text{ }\left( x,y \right)\text{ }=\text{ }h\left( x,y \right)*\text{ }f\left( x,y \right)\text{ }=\sum \underset{i,j=-\infty }{\overset{\infty }{\mathop \sum }}\,f\left( i,j \right)h\left( x-i,y-i \right)~

|

La diferencia entre la correlación cruzada y la convolución radica en que la máscara que se utiliza en la convolución se rota 180º, teniendo como punto de referencia el pixel central para hacer el giro. Conozca más sobre la convolución y correlación en imágenes. |

Actividad de aprendizaje

|

Le invitamos a realizar una actividad de correlación en imágenes, que le permitirá aplicar este concepto. |

Degradación y restauración

Métodos de deconvolución

La deconvolución (Deconvolution) se podría traducir como "enfoque de imágenes con ruido", es una metodología que ayuda a restaurar una imagen borrosa y obtener de ella la información adecuada. La comunidad científica le da relevancia a esta técnica cuando se corrige por medio de la deconvolución el daño que se presentaba en un telescopio espacial Hubbel, al cual se le corrige el desenfoque que tenían los lentes y captaban imágenes borrosas.

El fundamento de la deconvolución es una función matemática, la función de la extensión de punto (PSF: point spread function) del sistema óptico donde se tomaron las imágenes. Existen técnicas lineales y no lineales de deconvolución, pero en todas se necesita la PSF.

Un sistema de deconvolución consiste en un software específico con un hardware muy potente que, a través de complicadas interacciones matemáticas, permite calcular cuáles son los pixeles en foco y cuáles no, removiendo de la imagen todo aquello que corresponda a zonas del objeto que estén fuera de foco.

|

Conozca la clasificación de los métodos de deconvolución y el código para calcular la deconvolución en imágenes, en la siguiente interactividad. |

Actividad de aprendizaje

|

Le invitamos a realizar una actividad de método de deconvolución, que le permitirá aplicar este concepto. |

Morfología de la imagen

La lectura de la imagen en los seres humanos se da por medio de los ojos, quienes trasmiten las señales al cerebro y este les da un sentido recurriendo a su memoria, algunas partes de la imagen se ignoran y otras captan la atención. En las máquinas la información no tiene ningún sentido, son señales eléctricas convertidas en números, quien define la importancia de las partes son los algoritmos, las estructuras básicas que se identifican son las siguientes:

- El punto: es la unidad mínima que la conforma, la menor cantidad de pixeles.

- La línea: conjunto de puntos que se alinean para formar figuras, contornos, siluetas. Útiles para delimitar y separar campos.

- La forma: delimita un campo de pixeles que pueden dar sentido a una imagen.

- El tono: aplica para el color que tienen diferentes grados de blanco en su estructura.

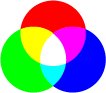

- El color: dependiendo de las ondas electromagnéticas que reflejan los objetos en donde llega la luz, se distinguen diferentes longitudes de onda que forman el color, la formación de los colores diversos lo dan las longitudes de onda del Rojo, Azul y Verde.

- La textura: Permite agregar a las imágenes valores sensoriales.

|

Con las operaciones morfológicas se puede simplificar las imágenes, conservando las características principales que las caracterizan. Identificando la morfología se suprime el ruido, se reduce el tamaño de las imágenes, se detecta la estructura de los objetos, se encuentran áreas y perímetros. |

Morfología de la imagen

Dilatación y erosión

Dilatación

Expande la imagen, es útil para resaltar partes de la imagen que sean de interés y necesita definir la estructura del elemento morfológico que indica la forma de la máscara que se va a utilizar.

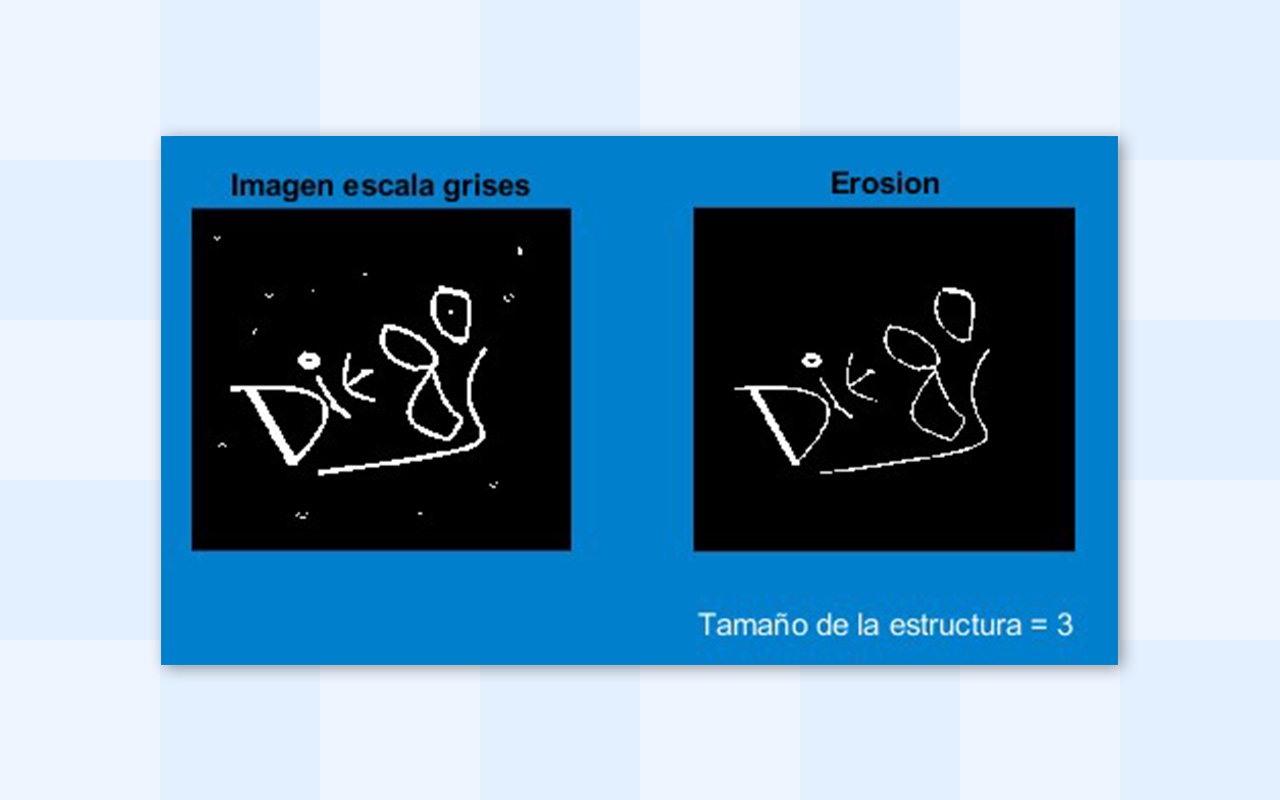

Erosión

Es útil para remover de las imágenes ruido pequeño y disperso, para utilizar esta técnica se debe definir la estructura del elemento morfológico que indica la forma de la máscara, que se va a utilizar para reducir o encoger la imagen a la cual se le aplica la erosión.

Actividad de aprendizaje

|

Le invitamos a realizar una actividad sobre la aplicación de la erosión y dilatación en imágenes. |

Morfología de la imagen

Coincidencia de plantillas

Para encontrar la coincidencia de imágenes y/o plantillas se recurre al cálculo del coeficiente de correlación, estaes una herramienta matemática que elimina la subjetividad al comparar las plantillas. La fórmula matemática que expresa el coeficiente de correlación de Pearson es:

{{\rho }_{X,Y}}=\frac{E\left[ \left( X-{{\mu }_{X}} \right)\left( Y-{{\mu }_{Y}} \right) \right]}{{{\sigma }_{X}}{{\sigma }_{Y}}}

El coeficiente de correlación es una medida del grado de asociación lineal entre dos variables cuantitativas, este puede tomar valores entre -1 y 1:

| Coeficiente C. | Indica | |

| ±0,00 | ±0,09 | Correlación nula |

| ±0,10 | ±0,19 | Correlación muy débil |

| ±0,20 | ±0,49 | Correlación débil |

| ±0,50 | ±0,69 | Correlación moderada |

| ±0.70 | ±0,84 | Correlación significativa |

| ±0,85 | ±0,95 | Correlación fuerte |

| ±0,96 | ±1,00 | Altamente correlacionado |

|

Conozca el algoritmo para encontrar el coeficiente de correlación entre dos matrices. |

Actividad de aprendizaje

|

Le invitamos a realizar la siguiente actividad que le permitirá cálcular el índice de correlación entre plantillas para identificar sus coincidencias. |

Morfología de la imagen

Usar operaciones morfológicas

Con las operaciones morfológicas se pretende cambiar las condiciones de la imagen para resaltar propiedades, eliminar objetos indeseables, identificar elementos. Con el siguiente algoritmo utilizando la erosión y la dilatación se logra extraer los bordes de los objetos, utilizando la morfología de la imagen. Tenga en cuenta el algoritmo a continuación para realizar la actividad:

- Paso 1. Leer la imagen y convertirla en escala de grises.

- Paso 2. Seleccionar un elemento de estructuración apropiado.

- Paso 3. Realizar la erosión de la imagen (imagen que encoge).

- Paso 4. Restar la imagen erosionada del original.

- Paso 5. Implementar el algoritmo y verificar su resultado.

Inspeccione el efecto con diferentes tamaños y diferentes tipos de elementos estructurados.

Actividad de aprendizaje

|

En la siguiente actividad podrá realizar un ejemplo de la operación morfológica. |

Extracción de características

Las aplicaciones para el procesamiento de imágenes requieren de la extracción de las características que tienen los objetos en las imágenes que se capturan, con el propósito de identificar matemáticamente y analizar los datos de las matrices que permitan tomar decisiones como:

- Encontrar el objeto de mayor o menor área.

- Contar los elementos.

- Ubicar los centroides de objetos para aplicaciones de seguimientos de trayectorias.

- Verificar el tamaño.

- Variaciones de áreas y perímetros.

- Eliminar ruido.

Y todas aquellas que se requieran para adecuar la información de forma optimizada.

Extracción de características

Centroides

Son las coordenadas del punto que pertenece a una figura. El centroide tiene diferentes significados dentro de la ingeniería como: centro de masa, el centro de gravedad, el centro de presión, el punto que define el centro de una línea, área o de un volumen. En el procesamiento de imágenes el término es usado de forma general para indicar las coordenadas que definen el centro geométrico de líneas, áreas y volúmenes.

Para el cálculo de los centroides se utilizan métodos geométricos que dan como resultado las coordenadas, por simplicidad, se calcula el centroide de figuras simples como el triángulo, círculo, rectángulo y a partir de estas se calculan los centroides de figuras más complejas.

Otro concepto que se relaciona con el cálculo de los centroides es la vecindad que existen entre los pixeles de una figura, los cuales se pueden agrupan de forma horizontal y vertical, diagonalmente se forman grupos de pixeles de 4 u 8 que están interconectados por sus caras y aristas. Un pixel tiene cuatro pixeles vecinos horizontales y cuatro pixeles vecinos verticales.

La vecindad de ocho pixeles está dada por relaciones directas e indirectas. Relacionada con la vecindad está la conectividad de los pixeles que es un concepto utilizado para establecer los límites en objetos y regiones de componentes de una imagen.

Para determinar la conectividad entre dos pixeles, se necesita establecer si son adyacentes con vecindad de 4 u 8 y su nivel de gris satisface un criterio determinado, este concepto permite identificar bordes y cambios inesperados en los tonos grises de los objetos que están en las imágenes.

Actividad de aprendizaje

|

Haga clic aquí para conocer el código y realizar una actividad sobre el cálculo de centroides en figuras geométricas. |

Extracción de características

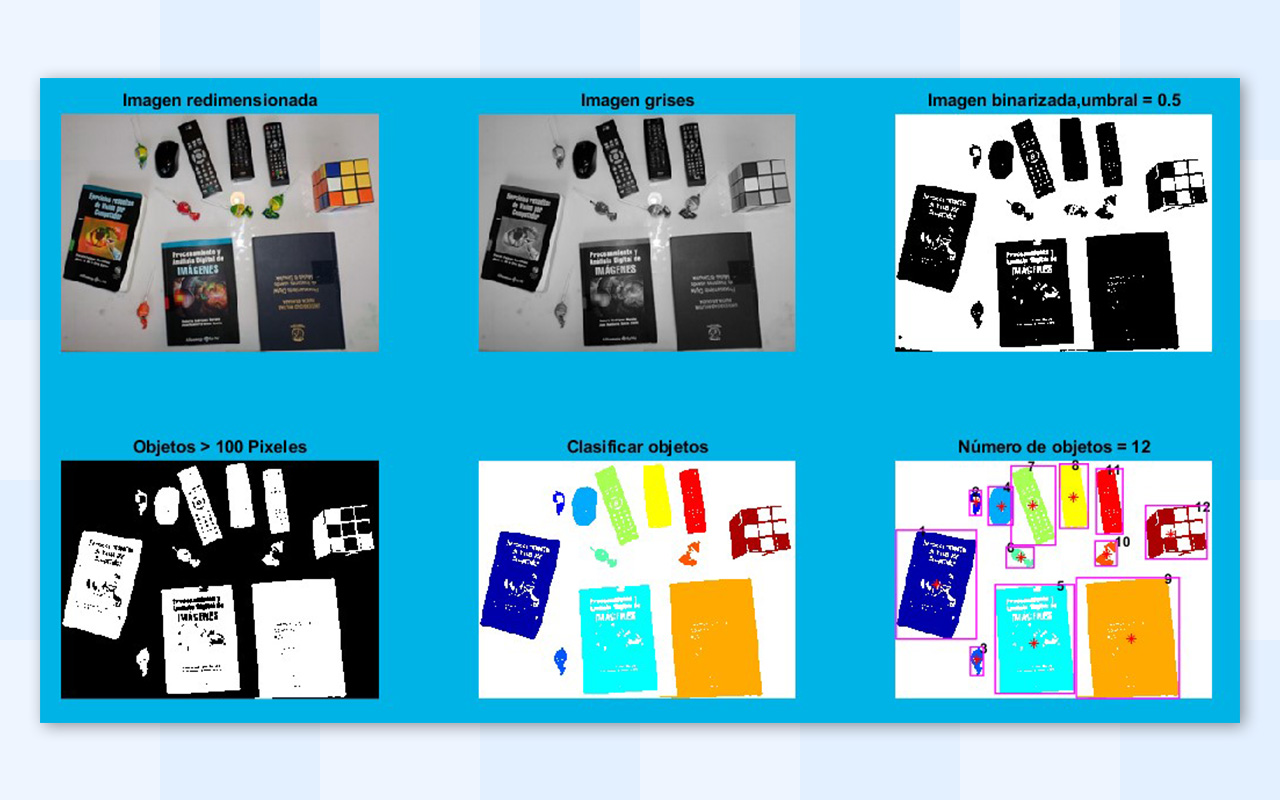

Contando objetos

Algoritmo para realizar el conteo de objetos en las imágenes

Paso 1. Redimensionamiento de la imagen

Capturar la imagen y archivarla, después se estandariza el tamaño con el cual se van a procesar las imágenes, el tamaño dependerá de la capacidad de procesamiento de los computadores y de los medios de transmisión de los datos. Por ejemplo, si se van a trasmitir por la red celular o es parte de una página web, se debe determinar el tamaño adecuado de la imagen sin perder información, permitiendo la mayor velocidad de transmisión y procesamiento.

|

Las imágenes almacenadas están en RGB, que es el formato más empleado, pero para simplificar el proceso se transforma la imagen a escala de grises, esto permite reducir las matrices tridimensionales a una sola, con el beneficio de tener la información apropiada y con el número de pixeles adecuado, ya que se pasa a una matriz que tiene datos uint8 más fáciles de manipular y que ocupan menos espacio. |

Paso 2. Binarización de la imagen en escala de grises

Esto genera una matriz con dos valores que son definidos por el umbral que permite determinar los niveles de datos, en donde “1” son aquellos mayores al umbral y “0” son menores del umbral. Para facilitar el cálculo de la matriz binaria el umbra esta entre 0 y 1, por ejemplo, puede ser umbral de 0.5. El valor del umbral se ajusta a las imágenes y los datos que se desean de salida para entregarlos al siguiente paso. Del umbral y la binarización va a depender la exactitud de los datos que se obtengan de las imágenes.

Paso 3. Determinar el número de pixeles

Se determina el número de pixeles o el área de los objetos que se van a clasificar y las áreas que se van a eliminar del proceso. Para determinar los pixeles que están en vecindad se niega la matriz binaria, este recurso matemático permite identificar los pixeles que están en vecindad y tienen conectividad para formar objetos. El número de pixeles de los objetos permite filtrar los que no se desean procesar como: el ruido que se origina en los dispositivos de captura o en el desenfoque al tomar fotografías, delimitar los objetos de interés y desechar los de bajo interés.

Paso 4. Clasificación

Se clasifican los objetos que han pasado los filtros previos. Para finalizar y entregar el resultado que se está buscando, que es extraer las características y clasificar los objetos, se calculan los centroides de los objetos.

|

En la siguiente figura puede ver el resultado de aplicar el algoritmo para realizar el conteo de objetos en las imágenes. |

Actividad de aprendizaje

|

Le invitamos a conocer el codigo y realizar una actividad sobre la extracción de características de las imágenes. |

Extracción de características

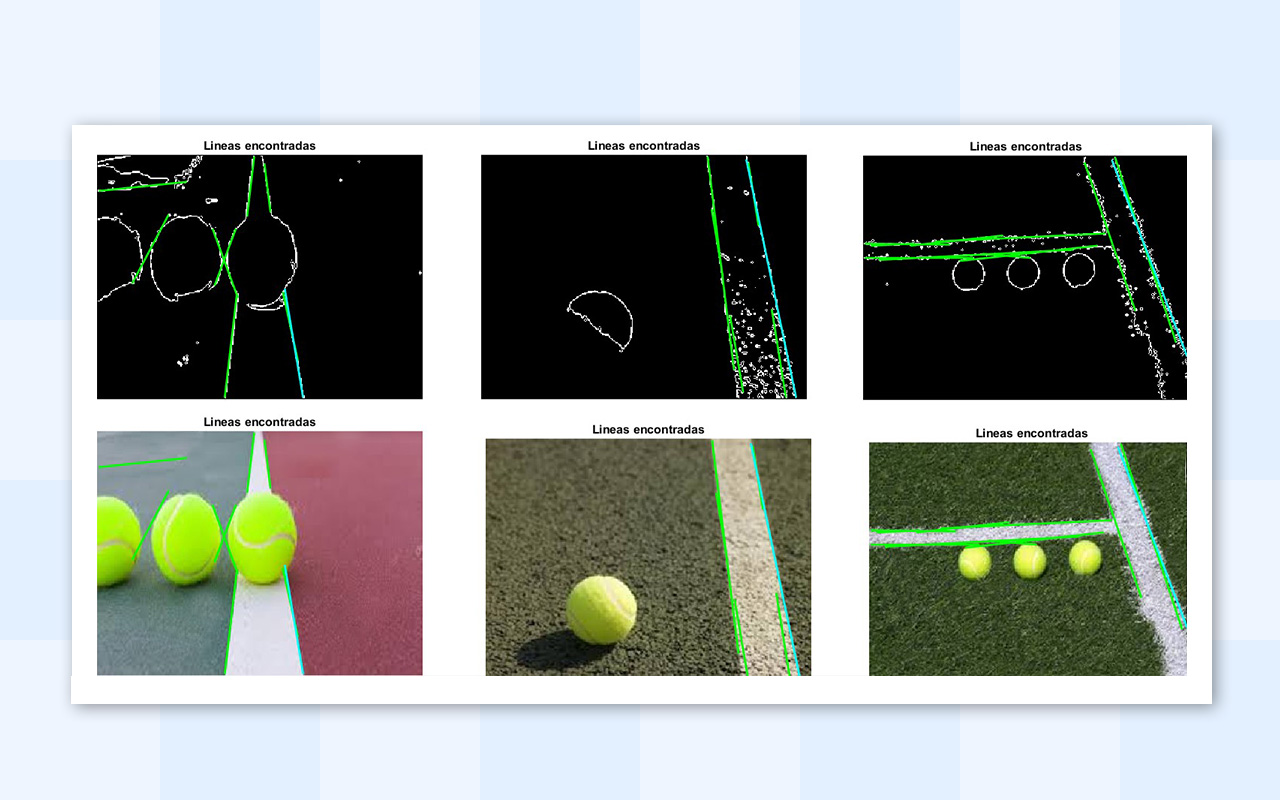

Detección de líneas y curvas

En la unidad anterior de esta asignatura, en la sección de transformaciones del dominio aplicado a procesamiento de imágenes, se trató la transformada que es las más adecuada para la detección de líneas y curvas. Recomendamos repasar de nuevo los conceptos vistos en la lectura “Transformada de Hough”.

Algoritmo para la detección de líneas y curvas

- Paso 1. Inicializar variables y cargar imagen.

- Paso 2. Convertir la imagen a escala de grises, la matriz debe ser uint8.

- Paso 3. Para el procesamiento y no perder información convertir el valor de los pixeles variables doublé.

- Paso 4. Con la matriz en escala de grises definir el umbral para calcular la nueva matriz binarizada.

- Paso 5. Configurar las variables de la transformada de Hough y los umbrales de binarización. Por ejemplo.

- Paso 6. Extraer los bordes de la imagen.

- Paso 7. Desplegar, si se necesita, las líneas calculadas por la TH o guardar los datos calculados para utilización posterior.

- Paso 8. Graficar puntos máximos encontrados por la matriz de acumulación de la TH.

Actividad de aprendizaje

|

Ahora que ya conoce el algoritmo para la detección de líneas y curvas, le invitamos a revisar el código para aplicar la transformada de Hough y a realizar la actividad de detección de líneas y curvas para verificar. |

Resumen

En la unidad se trataron diferentes técnicas para restaurar las imágenes que se adquieren de los dispositivos de captura, las cuales presentan deformaciones, ruidos, desenfoques y toda clase de distorsiones que evitan obtener los resultados esperados, se abordan varias técnicas que deben ser analizadas y aplicadas dependiendo de la información que se obtiene y el resultado esperado, por ejemplo, para eliminar ruido pequeño de las imágenes la técnica apropiada sería la deconvolución, para desarrollar un nuevo filtro que permita obtener datos de imágenes se aplica la convolución.

Para ampliar las características de los objetos, en las imágenes, la técnica apropiada es la dilatación, pero con un efecto negativo que es el de amplificar el ruido, por esta razón si las imágenes no tienen ruido esta es una alternativa apropiada.

Para identificar una firma borrosa en un documento la técnica para mejorarla sería la dilatación. En investigación, si desea crear un nuevo tipo de filtro para aplicar en las imágenes, la técnica apropiada es adicionar ruido aleatorio como salt&papper y verificar que el nuevo filtro actúa sobre el ruido.

El cálculo de centroides de objetos es útil para aplicaciones de seguimiento de trayectorias y para vigilar, contar objetos e identificar áreas, la extracción de características de las imágenes es la herramienta que mejor se acomoda a esta problemática.

Bibliografía ()

- Andrews, H. C. & Hunt, B. R. (1997). Digital Image Restoration. Prentice Hall.

- Cuevas, E., Zaldívar, D. & Pérez, Cisneros, M. (2010). Procesamiento digital de imágenes usando Matlab y Simulink. México: Alfaomega. Pág. 93-97.

- Giménez Palomares, F., Monsoriu, J. A. & Alemany Martinez, E. (2016). Aplicación de la convolución de matrices al filtrado de imágenes. Universidad Politécnica de Valencia. Modelling in Science Education and Learning, volumen 9(2).

- Katsaggelos. (1991). Digital Image Restoration. Springer

- Martínez, T. (2018). Transformada de Hough, Deteccion de líneas y círculos.

- McLean W. G. (1971). Mecánica Técnica. Mexico: McgrawHill, segunda edición.

Referencias Web

- Cognex.com. (2020). Página principal. Recuperado de: https://www.cognex.com/applications.

- MathWorks. (2020). Documentación. Recuperado de: https://la.mathworks.com/help.